El grup CRISES, referent internacional des de fa molts anys, centra la intensa recerca de la URV al voltant de la seguretat i la privadesa en entorns informàtics i digitals, amb la gestió de la intel·ligència artificial com a repte afegit

“És com una cursa constant entre els atacants cibernètics i els que treballem per garantir la seguretat, en què es tracta de ser més ràpids i més llestos.” Oriol Farràs, un dels membres del grup de recerca CRISES de la Universitat Rovira i Virgili, referent internacional en ciberseguretat, té tot un repte: avançar-se al desenvolupament dels ordinadors quàntics, que, segons algunes previsions, acabaran substituint els ordinadors convencionals i desmuntaran els protocols actuals de seguretat cibernètica. Si la computació quàntica, que superposa i entrellaça dades per la seva capacitat d’estar en dos estats simultàniament, la qual cosa li permet resoldre càlculs molt complexos, continua evolucionant, es preveu que es creïn ordinadors potents i cada cop més estesos que podrien desxifrar informacions encriptades amb molta més facilitat que els convencionals.

“Es tracta, per tant, de trobar esquemes alternatius, nous estàndards de seguretat que continuïn sent difícils de desxifrar i que no siguin vulnerables a atacs quàntics”, explica Oriol Farràs, que recorda el perill que per a la seguretat suposaria la possibilitat de trobar portes d’entrada a blockchains (llibres de comptabilitat i dades compartits), a aplicacions de missatgeria, a canals de comunicació segura amb navegadors… O de falsificar o fer un us fraudulent de signatures digitals, amb el que tot això implica.

Així, la feina d’Oriol Farràs es basa, per una banda, en trobar problemes matemàtics, mètodes de xifratge, cada cop més robustos i, per altra, en desenvolupar acceleradors per als nous estàndards de seguretat, que de moment són massa lents, en col·laboració amb el Barcelona Supercomputing Center. “Hem d’aconseguir que la seguretat postquàntica no impliqui grans demores o repercussions negatives en la comunicació digital”, afirma.

La cursa és constant, sense final, ja que cal garantir la seguretat sabent que els mateixos avenços tecnològics en què es basa la recerca són els que faciliten els atacs. Cal anar neutralitzant les amenaces a mesura que en sorgeixen de noves.

La línia d’investigació d’Oriol Farràs és una de les principals en què es treballa des del grup CRISES-Security & Privacy del Departament d’Enginyeria i Matemàtiques de la URV, que fa més de dues dècades que es dedica a fer recerca sobre ciberseguretat i privadesa. “Hi ha un moment en què internet es generalitza, tothom està connectat i és quan la gent s’adona que hi ha problemes de ciberseguretat. Apareixen virus, atacs cada cop més sofisticats, i és quan veiem que cal investigar a fons.” Ho explica Josep Domingo-Ferrer, director del grup de recerca i l’investigador més citat de l’estat en ciberseguretat i el vint-i-vuitè del món. Domingo-Ferrer també coordina des de la URV el CYBERCAT, el centre de recerca en ciberseguretat de Catalunya que agrupa set grups de recerca de sis universitats del país.

“Cada cop més part de la nostra vida té lloc en el món virtual. Tradicionalment n’hi havia prou assegurant el món físic, amb policia i exèrcit, però en aquest moment cal assegurar el virtual. Sense seguretat no hi ha civilització, i per això és bàsic, però també cal garantir, per exemple, la privadesa, que la teva vida no estigui exposada”, explica Domingo-Ferrer. De fet, segons ell, “cal ser més gelosos de la privadesa en el món virtual que en el físic ja que no pots veure qui t’està observant, i qui t’observa pot ser que no tingui bones intencions”.

En els temps actuals, la intel·ligència artificial és una eina que facilita molt les coses a tots els nivells, però també obre un nou front en la cursa per la seguretat i la privadesa. En aquest sentit, Josep Domingo-Ferrer i un altre catedràtic del grup, David Sánchez, centren la seva línia d’investigació en fer que la IA sigui confiable, és a dir, que no pugui ser atacada per distorsionar-ne l’aprenentatge i que les dades d’entrenament, les que s’utilitzen per desenvolupar-la i que generalment són privades, no puguin ser compartides més enllà d’aquesta funció.

La cursa és constant, sense final, ja que cal garantir la seguretat sabent que els mateixos avenços tecnològics en què es basa la recerca són els que faciliten els atacs

Treballen, per exemple, al voltant de l’anomenat oblit digital. “El reglament general de protecció de dades diu que tothom té dret que les seves dades desapareguin dels sistemes informàtics, que per exemple Google no retorni resultats que tu no vols que retorni”, explica Domingo, que assegura que aquest dret és més difícil de garantir en models de llenguatge com ara el ChatGPT, ja que han estat entrenats amb totes les dades disponibles i costa més destriar les dades que en un moment donat algú demana que siguin eliminades: “Per tant, per eliminar del tot aquestes dades caldria tornar a entrenar el model des de zero, la qual cosa seria molt costosa. De totes maneres, existeixen mètodes de desaprenentatge que ho fan de manera més ràpida, però sense garantia total. El que nosaltres cerquem són models que siguin prou ràpids i que donin el màxim de garanties de privadesa.”

L’equilibri entre seguretat i privadesa també és una de les preocupacions de Rolando Trujillo. Per exemple, aquest investigador treballa en un projecte, amb la col·laboració d’empreses de comunicació, que busca comprovar si un sistema per lluitar contra la desinformació, que es dedica a autenticar imatges i vídeos que circulen per internet, compleix amb els seus objectius i, al mateix temps, amb la privadesa: “Com que per validar la imatge s’hi afegeix una signatura, es posa en entredit la privadesa ja que es facilita la identitat de qui ha fet la fotografia. El que hem de fer és calibrar aquest balanç entre privadesa i informació contrastada.”

Principalment, Trujillo es dedica a buscar mètodes formals per comprovar la seguretat d’un producte de manera automàtica: “Qualsevol sistema informàtic té un període de prova per saber si la implementació del software i el disseny compleixen amb les propietats que se li demanen. És a dir, que no implementi funcions addicionals, ja que són les explotades pels hackers, que disposen així portes d’entrada. És fàcil definir què esperem del software, però no tant definir el que no n’esperem. Per tant, intentem demostrar de manera matemàtica, donada una especificació d’un software, com per exemple l’aplicació de missatgeria de Whatsapp, que compleix exactament amb les propietats que se n’esperen, és a dir, si es manté robust davant l’amenaça dels hackers.”

Els tipus de software que intenta verificar Rolando Trujillo són, generalment, protocols de seguretat d’aplicacions de missatgeria o els que s’utilitzen en les targetes de pagament, per exemple, els que verifiquen la proximitat entre dos dispositius per assegurar que el pagament es fa a la terminal que toca.

Els investigadors de CRISES busquen una demostració matemàtica per obtenir una valoració objectiva del grau de seguretat d’un sistema. Aquestes eines de verificació formal s’encarreguen d’explorar tots els estats possibles del software (en una aplicació de missatgeria són, per exemple, l’enviament, la resposta, el fet d’estar en línia…) i quan detecta a través d’una fórmula matemàtica que n’hi ha un d’invàlid, en què es viola una propietat de seguretat, avisa i informa del camí a través del qual hi ha arribat, que seria el que seguiria el hacker. “El nostre treball ajuda a trobar, a través de raonaments per ordinador, errors molt subtils que s’escapen dels ulls humans i que poden ser camins d’entrada per a atacs”, explica.

La dificultat és que cal certa abstracció ja que el món real és molt difícil de definir de manera precisa, i sovint demostrar que certa propietat es compleix no és fàcil perquè les eines sovint no poden resoldre situacions no decidible, és a dir, que no són certes o falses, sinó que hi ha matisos que fa que calgui ajudar-les, reforçar-les, per exemple mitjançant teoremes. “Estem, per tant, entre la computació i les matemàtiques”, apunta Trujillo, nascut a Cuba i que, després de llargues estades a Luxemburg i Austràlia, ha tornat a la URV, on temps enrere va defensar la tesi doctoral sobre, precisament, protocols de seguretat que no impliquin un augment dels costos dels dispositius.

L’expansió d’internet, i la seva implementació en objectes quotidians, també augmenta les possibilitats tecnològiques, però, com en la cursa a què feia referència Oriol Farràs, obliga als investigadors a mantenir el ritme i actualitzar les seves recerques. És el cas de Jordi Castellà, expert en la seguretat del vehicle connectat. Per exemple, tracta l’accés dels cotxes a les zones de baixes emissions de les àrees urbanes, amb moltes càmeres que registren matrícules. “La privadesa, per tant, està molt en entredit amb aquestes càmeres, ja que es poden saber els moviments de molta gent, on viuen, a quina hora i on van a treballar… L’aposta és fer-ho des dels dispositius mòbils, a través dels quals s’avisa que hi podem accedir però sense identificar-nos. I, qui no hi pugui entrar i ho faci, llavors sí que serà identificat.” L’eliminació de la privadesa com a càstig. Segons Castellà, les mateixes càmeres dels vehicles es poden aprofitar per controlar els altres cotxes i per reportar situacions irregulars.

Tots els projectes estan preparats per ser aplicats quan els calgui a les administracions, sempre amatents als avenços d’un grup de recerca que consideren capdavanter

La privadesa també es posa en risc en la xarxa intel·ligent d’electricitat a través de panells solars, en què els mateixos consumidors d’energia en són productors. “Com que cal fer previsions amb els històrics de consum es necessiten dades, i hi ha el perill que si aquestes dades són massa públiques es puguin saber tots els moviments que es fan a cada casa. Si s’automatitza amb mètodes intel·ligent, la informació hi és igualment, però es protegeix la privacitat de cada usuari”, raona Castellà.

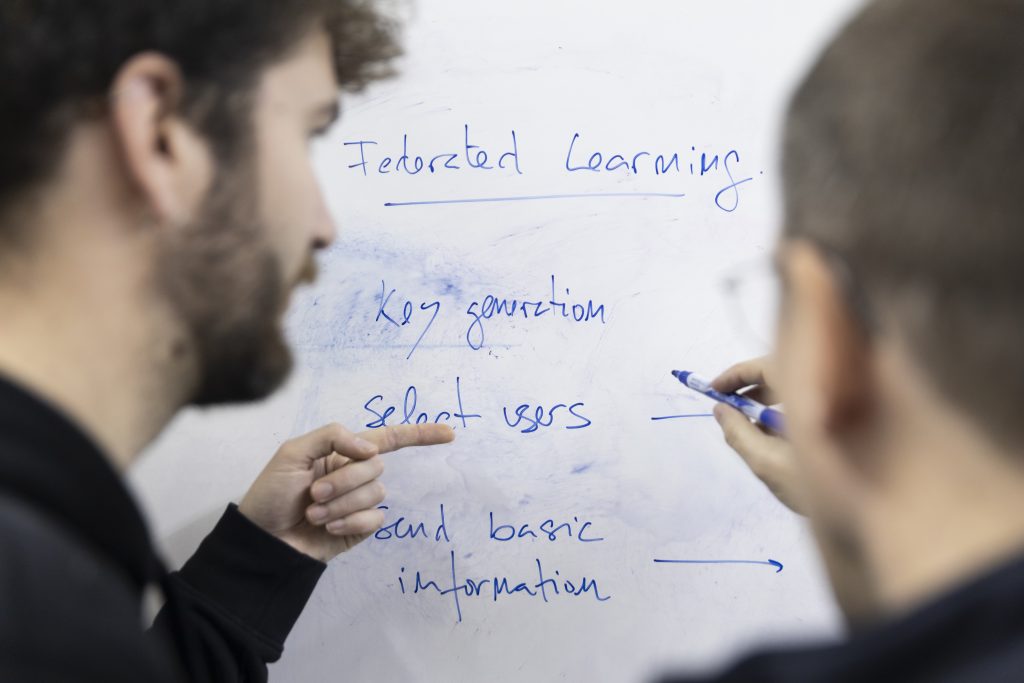

Per exemple, s’aconsegueix entrenant la intel·ligència artificial amb moltes dades de consum, que els mateixos usuaris poden donar però sense identificar-se. És l’anomenat aprenentatge federat. Com més dades, més ajustada serà la previsió, i també els ajustaments automàtics del consum per fer-lo més eficient, i menys visibles seran les dades individuals.

Tot i això, perquè les dades que alimenten la IA siguin realment fiables, cal tenir permís i cal saber-ne la traçabilitat (d’on venen, quins condicionants tenen…), però en els dos casos garantint la privadesa. En aquest sentit, els smart contracts (contractes intel·ligents) entre usuaris i empreses són clau per garantir la privadesa, ja que hi consta a què s’ha donat permís i es poden cancel·lar o actualitzar en qualsevol moment. “El repte és mantenir aquesta traçabilitat perquè les dades siguin fiables, però sense desvetllar-ne l’origen. Garantir, al mateix temps, la traçabilitat i la privadesa”, conclou Castellà.

Molta d’aquesta recerca es fa en col·laboració amb empreses, de les quals s’obté informació per avançar amb els estudis i feedback, i en contacte amb les administracions, amatents a qualsevol avenç en matèria de ciberseguretat i privadesa i que tenen els investigadors del grup CRISES de la URV entre els referents en aquest àmbit. “L’expectativa és que el coneixement que desenvolupem internament, tant el que surt de l’activitat acadèmica com que la desenvolupem inspirant-nos en l’activitat privada, acabi sent usat per empreses i per administracions”, afirma Rolando Trujillo. Pel que fa a l’activitat acadèmica, la URV imparteix des de fa anys el Màster universitari en Enginyeria de la Seguretat Informàtica i Intel·ligència Artificial. “Tots els nostres projectes estan preparats per ser aplicats quan calgui a les administracions”, apunta Jordi Castellà.

La ciberseguretat és de gran importància en el context internacional actual, amb blocs polaritzats i amenaces bèl·liques i terroristes latents. És per això, tal i com recorda Josep Domingo-Ferrer, que el doble us, civil i militar, de molts dels avenços que es tirin endavant en aquests camps es té molt en compte a l’hora de finançar projectes. Domingo-Ferrer té clar que s’han de preservar valors, no només la privadesa sinó d’altres com ara l’equitat, la no discriminació, el respecte i el diàleg, i que en un moment en què el populisme i el reforçament dels estats estan en auge, és Europa qui les ha de garantir. Però també avisa que l’excés de zel al voltant, per exemple, de les implicacions ètiques de la intel·ligència artificial, exagerar-les, pot ser contraproduent i fer que Europa, el bloc més feble tecnològicament, es continuï allunyant dels altres.

De fet, Domingo-Ferrer explica que David Sánchez i ell encapçalen una línia de recerca per establir quins són els perills reals, amb arguments tecnològics i científics, que pot tenir la IA i la gestió de dades per tal que els que manen facin lleis realistes. De fet, Europa està disposada a flexibilitzar les lleis al voltant de la intel·ligència artificial, ja que, com recorda Josep Domingo, s’està demostrant que els riscos per a la privadesa s’han exagerat i s’ha creat un alarmisme no prou justificat. En definitiva, que en aquesta cursa de fons els valors siguin una motivació per mantenir la davantera, però no pas una càrrega excessiva que doni avantatge al perseguidor.